源码

杂谈

高光谱图像

.md预览

文字

html5期末大作业

AppCube

exe

虚函数表和虚表指针

mysql存储过程

Semaphore

flownet

语法

condition

heartbeating

oceanbase

filter

太空工程师

gitea

Eolink

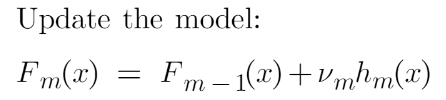

boosting

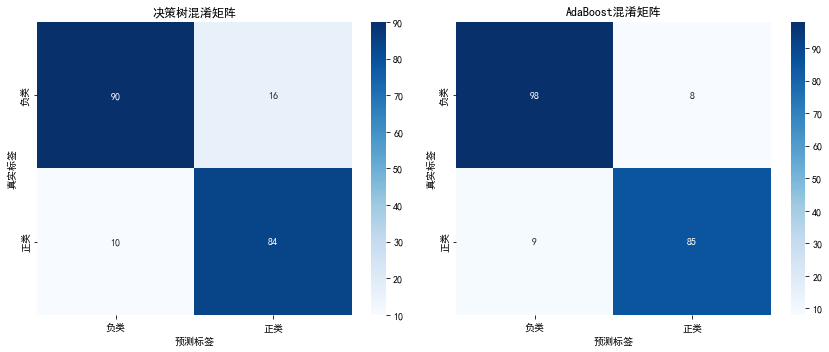

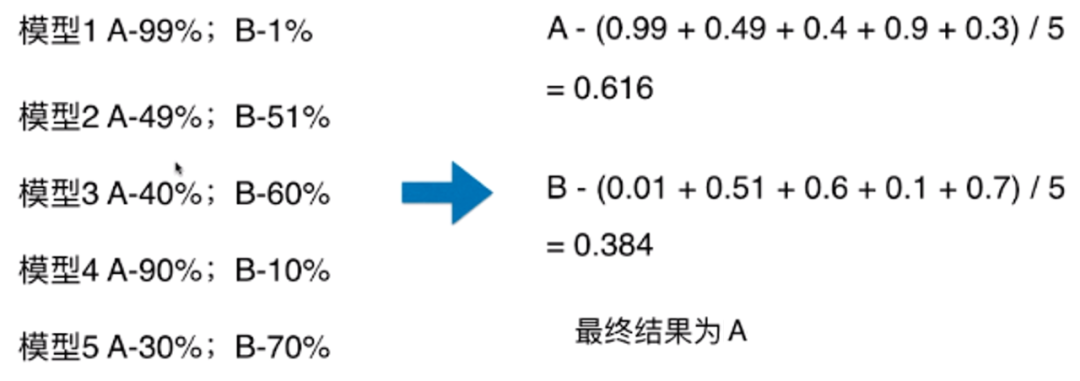

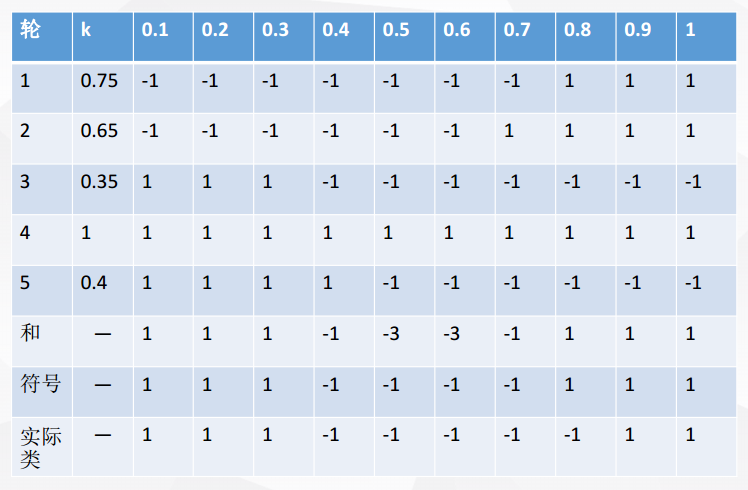

2024/4/12 6:17:11西瓜书学习笔记——Boosting(公式推导+举例应用)

文章目录 引言AdaBoost算法AdaBoost算法正确性说明AdaBoost算法如何解决权重更新问题?AdaBoost算法如何解决调整下一轮基学习器样本分布问题?AdaBoost算法总结实验分析 引言

Boosting是一种集成学习方法,旨在通过整合多个弱学习器来构建一个…

<集成学习算法(Ensemble Methods)>——《机器学习算法初识》

目录

一、集成学习算法简介

1 什么是集成学习

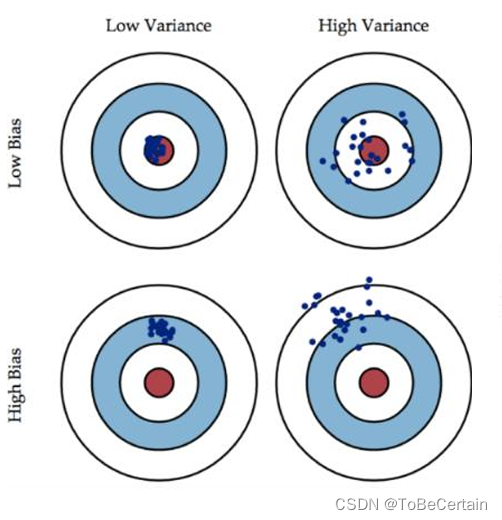

2 复习:机器学习的两个核心任务 ★★★

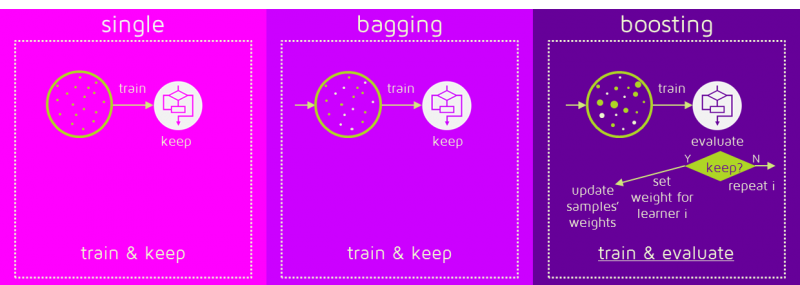

3 集成学习中boosting和Bagging

4 小结

二、Bagging和随机森林

1 Bagging集成原理

2 随机森林构造过程

3 包外估计 (Out-of-Bag Estimate)

3.1 包外估计的定义

3.2 包…

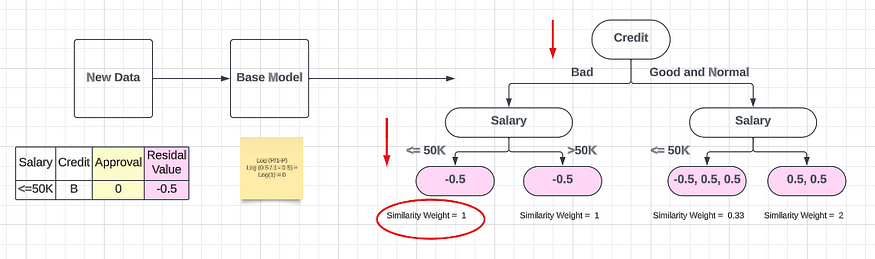

机器学习——boosting之GBDT

现在要开始重点关注名字了,名字透漏了很多信息!名字暗藏线索! GBDT,Gradient Boosting Decision Tree: 梯度提升决策树

果然信息很丰富

梯度:意味着计算有迭代递进关系,但还不明确是怎么迭代递进的 提升&…

AdaBoost算法(一)——基础知识篇

AdaBoost算法(一)——基础知识篇集成学习系列博客:

集成学习(ensemble learning)基础知识随机森林(random forest)AdaBoost算法(一)——基础知识篇AdaBoost算法…

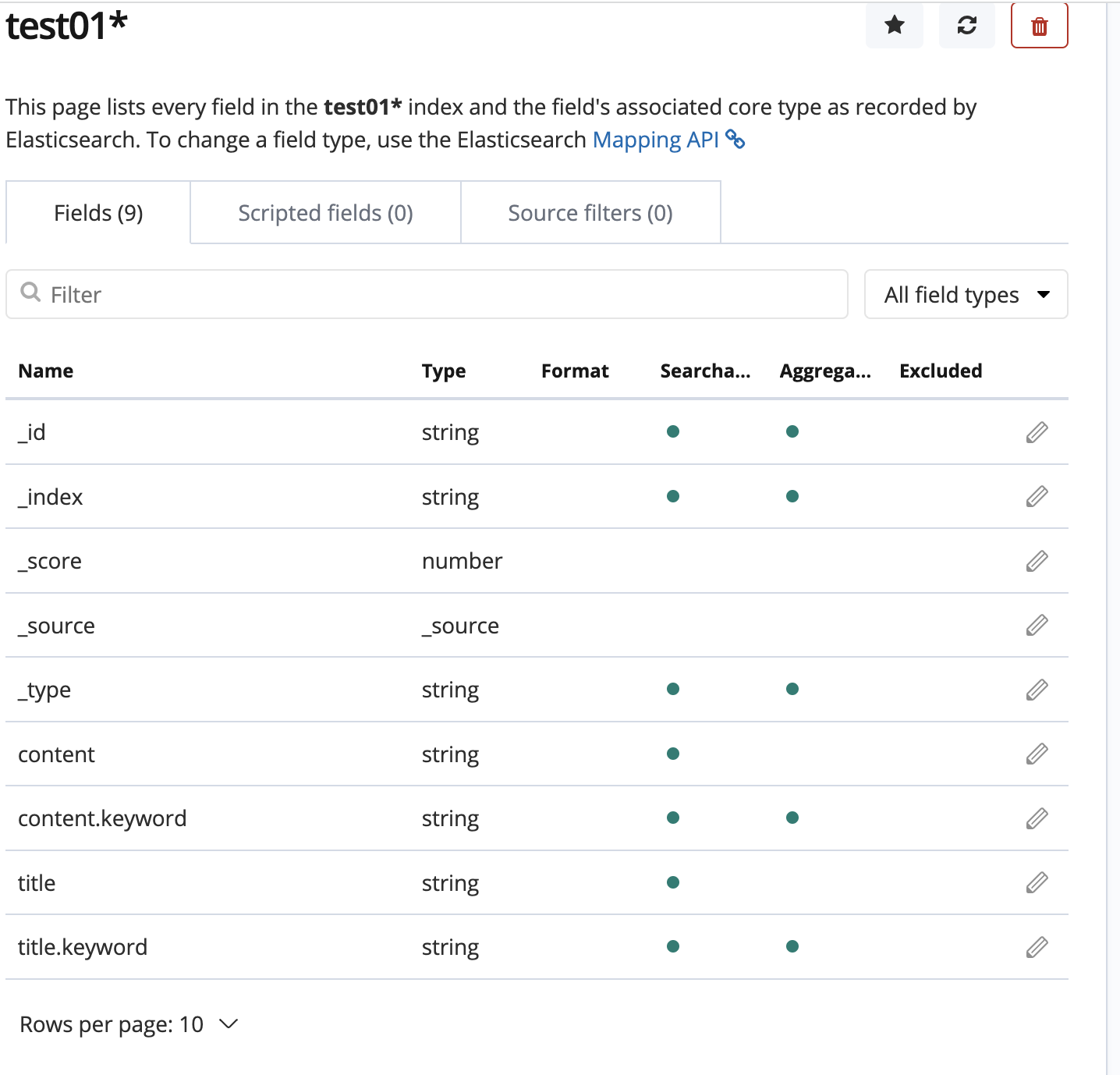

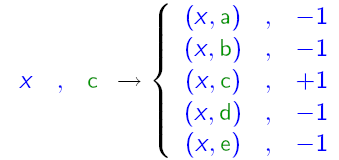

Elasticsearch复合查询之Boosting Query

前言

ES 里面有 5 种复合查询,分别是:

Boolean QueryBoosting QueryConstant Score QueryDisjunction Max QueryFunction Score Query

Boolean Query在之前已经介绍过了,今天来看一下 Boosting Query 用法,其实也非常简单&…

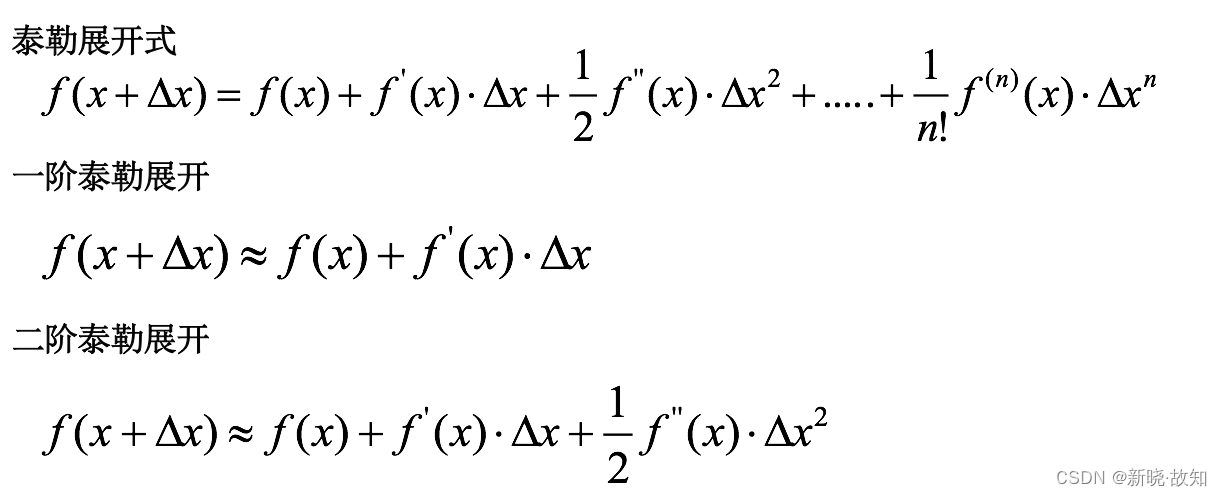

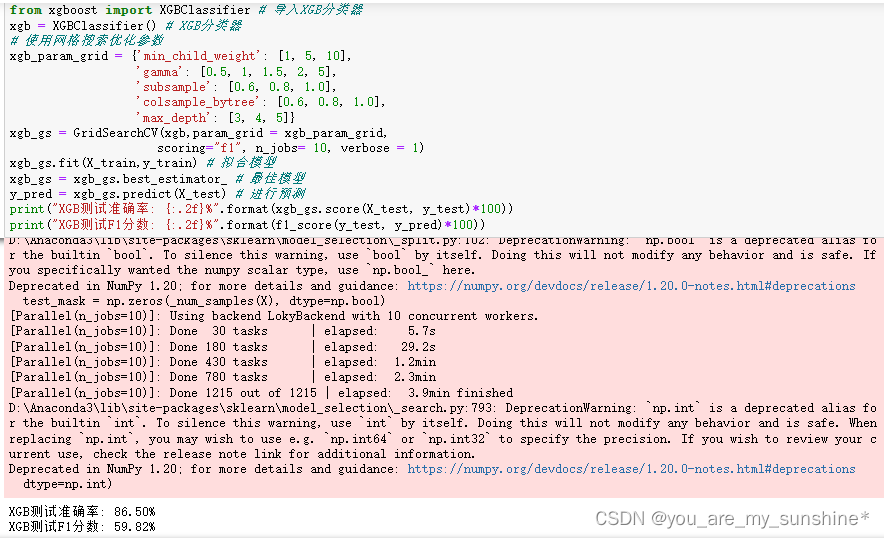

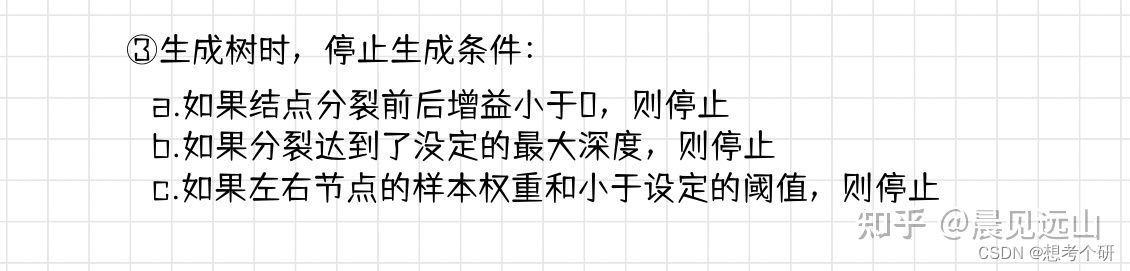

【机器学习】XGBoost 详细解读 (集成学习_Boosting_GBM)

【机器学习】XGBoost 详细解读 (集成学习_Boosting_GBM) 文章目录 【机器学习】XGBoost 详细解读 (集成学习_Boosting_GBM)1. 介绍2. 基本原理3. 目标函数(二阶泰勒展开求解)3.1 基础的目标函数3.2 二阶泰勒…

mmlspark.lightgbm.LightGBMClassifier参数说明

LightGBMClassifier参数说明 mmlspark.lightgbm.LightGBMClassifier 是一个用于二元分类和多类分类的机器学习模型,它是基于 Microsoft ML for Apache Spark (MMLSpark) 库的。这个类是为了在Spark环境中使用LightGBM实现,提供了大量的参数用于调整模型。…

GBDT 之 Boosting方法

Boosting方法概述

Boosting方法是一种用来提高弱分类算法准确度的方法,这种方法通过构造一个预测函数系列,然后以一定的方式将他们组合成一个预测函数。他是一种框架算法,主要是通过对样本集的操作获得样本子集,然后用弱分类算法在样本子集上训练生成一系列的基分类器。他可以…

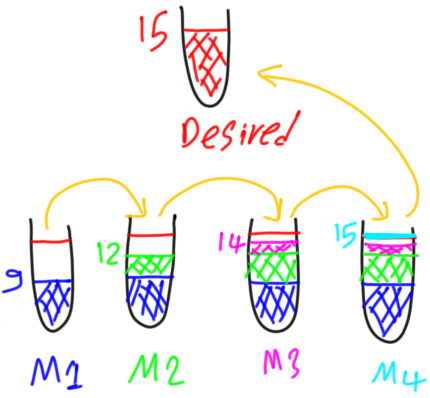

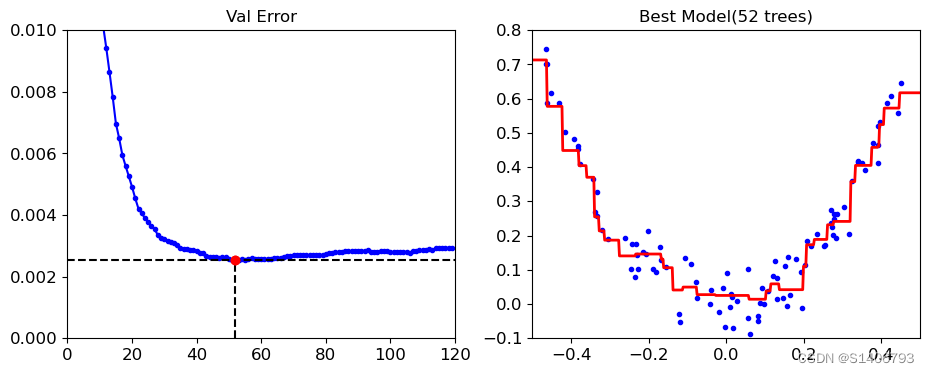

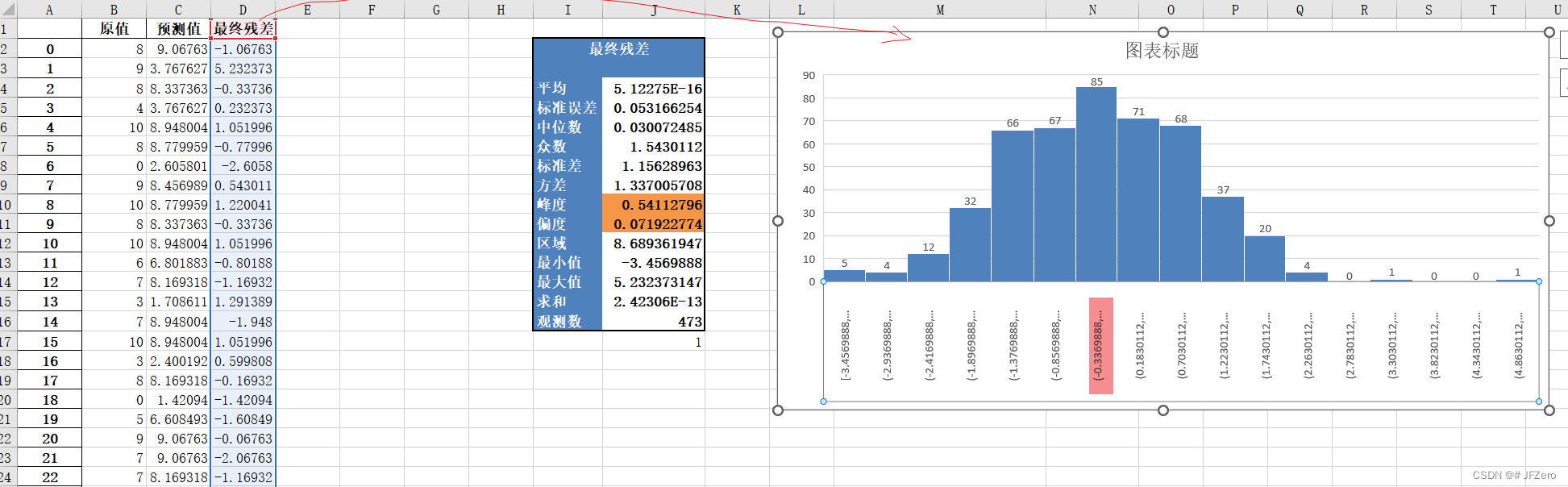

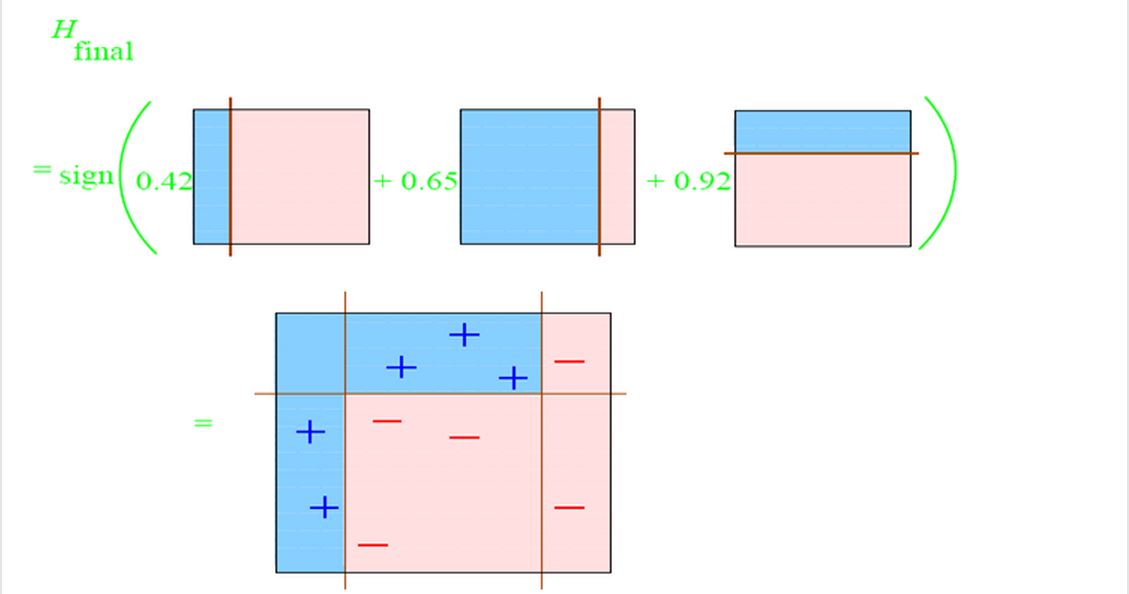

集成学习算法梯度提升(gradient boosting)的直观看法

reference: Intuitive Ensemble Learning Guide with Gradient Boosting 文章目录几句话总结全文IntroductionEnsemble LearningGradient Boosting (GB)梯度提升的总结几句话总结全文

梯度提升算法的核心思想:使用前一个模型的残差作为下一个模型的目标…

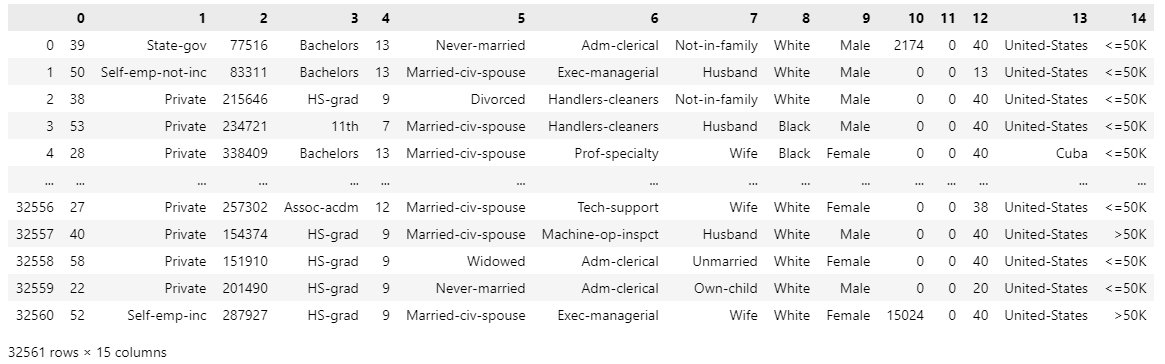

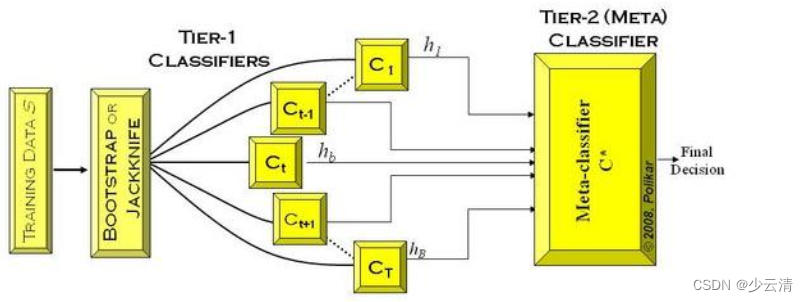

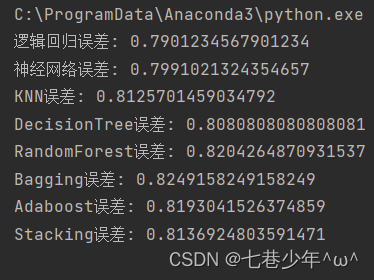

数据挖掘终篇!一文学习模型融合!从加权融合到stacking, boosting

模型融合:通过融合多个不同的模型,可能提升机器学习的性能。这一方法在各种机器学习比赛中广泛应用, 也是在比赛的攻坚时刻冲刺Top的关键。而融合模型往往又可以从模型结果,模型自身,样本集等不同的角度进行融合。 数据…

机器学习 | 如何利用集成学习提高机器学习的性能?

目录

初识集成学习

Bagging与随机森林

Otto Group Product(实操)

Boosting集成原理 初识集成学习

集成学习(Ensemble Learning)是一种通过组合多个基本模型来提高预测准确性和泛化能力的机器学习方法。它通过将多个模型的预测结果进行整合或投票来做…

集成学习 | 集成学习思想:Boosting

目录 一. Boosting思想1. Adaboost 算法1.1 Adaboost算法构建流程1.2 sklearn库参数说明 2. Gradient Boosting 算法2.1 Gradient Boosting算法构建流程2.2 Gradient Boosting算法的回归与分类问题2.2.1 Gradient Boosting回归算法均方差损失函数绝对误差损失函数 2.2.2 Gradie…

深度学习笔记之残差网络(ResNet)

深度学习笔记之残差网络[ResNet] 引言引子:深度神经网络的性能问题核心问题:深层神经网络训练难残差网络的执行过程残差网络结构为什么能够解决核心问题残差网络的其他优秀性质 引言

本节将介绍残差网络( Residual Network,ResNet \text{Residual Netwo…

监督学习 - 梯度提升机(Gradient Boosting Machines,GBM)

什么是机器学习

梯度提升机(Gradient Boosting Machines,GBM)是一种集成学习方法,通过将多个弱学习器(通常是决策树)组合成一个强学习器来提高模型的性能。GBM的训练过程是通过迭代,每一步都根…

XGBoost(eXtreme Gradient Boosting)

XGBoost(eXtreme Gradient Boosting)是一种梯度提升树算法,它在梯度提升框架的基础上引入了一些创新性的特性,以提高模型性能和训练速度。XGBoost在解决结构化数据的分类和回归问题上表现出色,成为许多数据科学竞赛中的…

牛客网算法八股刷题系列(一)Boosting相关

牛客网算法八股刷题系列——Boosting相关题目描述正确答案:D\mathcal DD题目解析题目描述

下面关于AdaBoost\text{AdaBoost}AdaBoost算法的描述中,错误的是 ()(\quad)() A\mathcal A \quadA AdaBoost\text{AdaBoost}AdaBoost模型是弱分类器的线性组合&a…

AdaBoost(Adaptive Boosting)详细说明

AdaBoost(Adaptive Boosting)是一种用于二分类问题的集成学习算法,通过结合多个弱分类器来构建一个强分类器。以下是AdaBoost算法的详细说明:

基本思想: 初始化权重: 对每个样本赋予初始的权重,…

Bagging的随机森林;Boosting的AdaBoost和GBDT

集成学习应用实践

import numpy as np

import os

%matplotlib inline

import matplotlib

import matplotlib.pyplot as plt

plt.rcParams[axes.labelsize] 14

plt.rcParams[xtick.labelsize] 12

plt.rcParams[ytick.labelsize] 12

import warnings

warnings.filterwarnin…

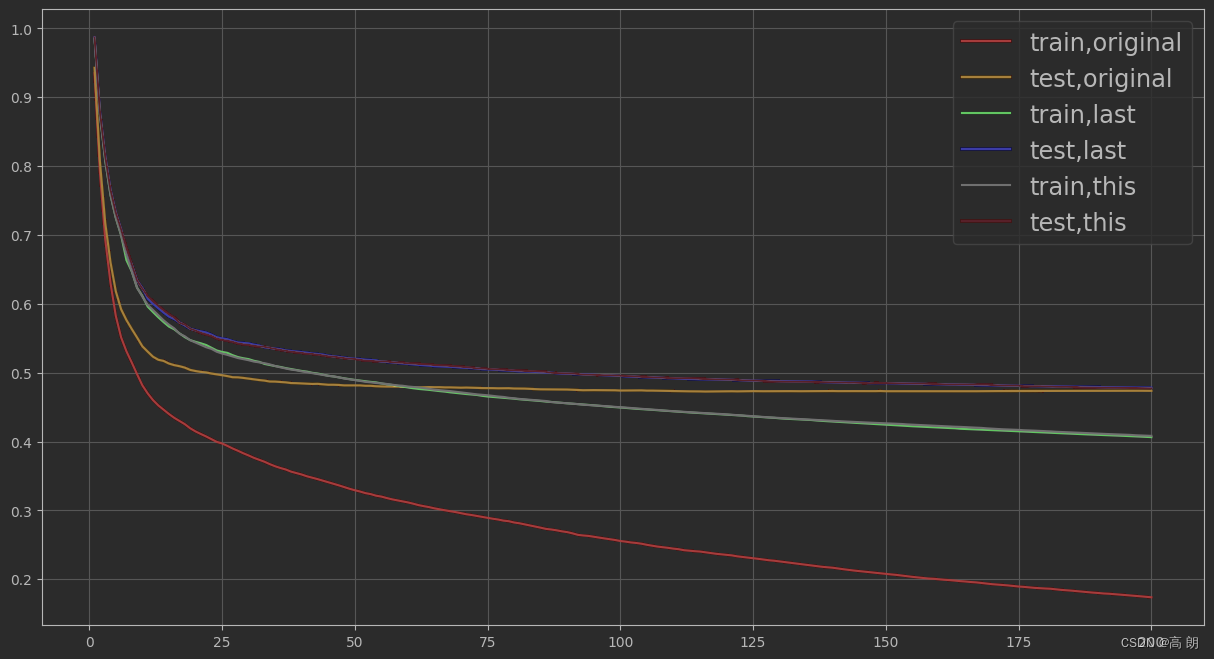

【机器学习】集成学习Boosting

文章目录 集成学习BoostingAdaBoost梯度提升树GBDTXGBoostxgboost库sklearn APIxgboost库xgboost应用 集成学习

集成学习(ensemble learning)的算法主要包括三大类:装袋法(Bagging),提升法(Boo…

《机器学习公式推导与代码实现》chapter12-XGBoost

《机器学习公式推导与代码实现》学习笔记,记录一下自己的学习过程,详细的内容请大家购买作者的书籍查阅。

XGBoost

从算法精度、速度和泛化能力等性能指标来看GBDT,仍然有较大的优化空间。XGBoost是一种基于GBDT的顶级梯度提升模型。相较于…

notion插件:为你的工作流带来新生

在本文中,我们将介绍Notion的几款有助于提高生产力的插件。这些插件将加强Notion的功能,并为你的工作流程带来更多的便利。 我们特地为你准备了这本漫游指南:收录各种工具、信息和资源,携你共同探索浩瀚美丽的互联网海洋。 snackt…

AdaBoost算法(二)——理论推导篇

AdaBoost算法(二)——理论推导篇集成学习系列博客:

集成学习(ensemble learning)基础知识随机森林(random forest)AdaBoost算法(一)——基础知识篇AdaBoost算法…

集成学习法之bagging方法和boosting方法

一、集成学习法(Ensemble Learning)

首先,让我们先来了解一下,什么是集成学习法。 ① 将多个分类方法聚集在一起,以提高分类的准确率。

(这些算法可以是不同的算法,也可以是相同的算法。&…

模型集成系列:Bagging和Boosting方法

模型集成系列:Bagging和Boosting方法

本文讨论Bagging和Boosting。这些(Bagging和Boosting)是全世界数据科学家常用的术语。但是这些术语究竟是什么意思,它们如何帮助数据科学家。我们将学习关于bagging和boosting以及它们在实践…

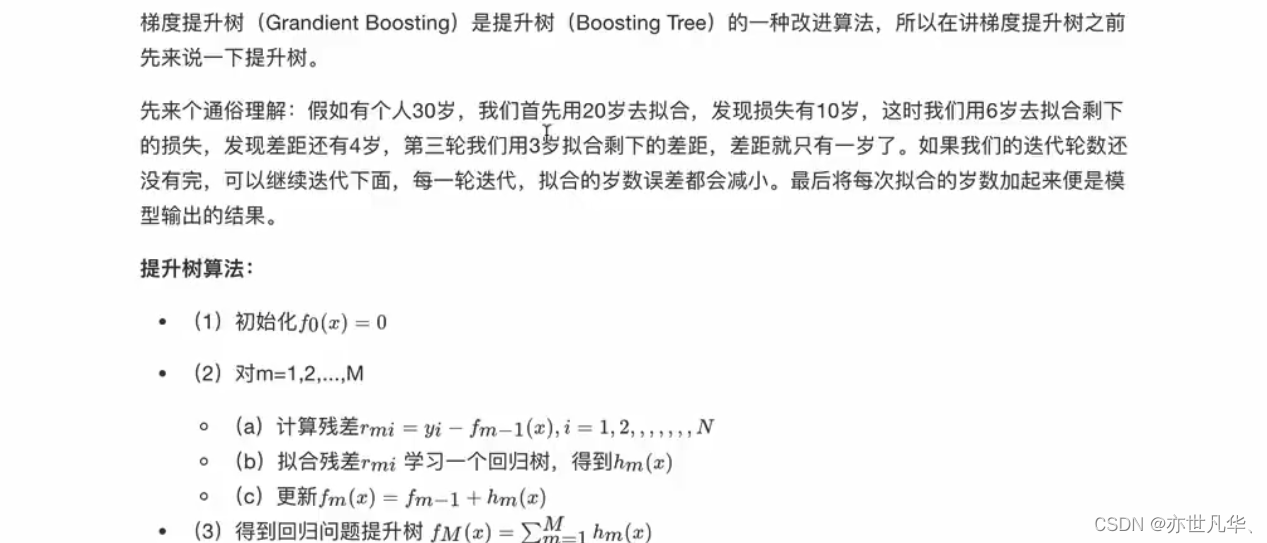

机器学习——boosting之提升树

提升树和adaboost基本流程是相似的 我看到提升树的时候,懵了 这…跟adaboost有啥区别??? 直到看到有个up主说了,我才稍微懂 相当于,我在adaboost里的弱分类器,换成CART决策树就好了呗࿱…

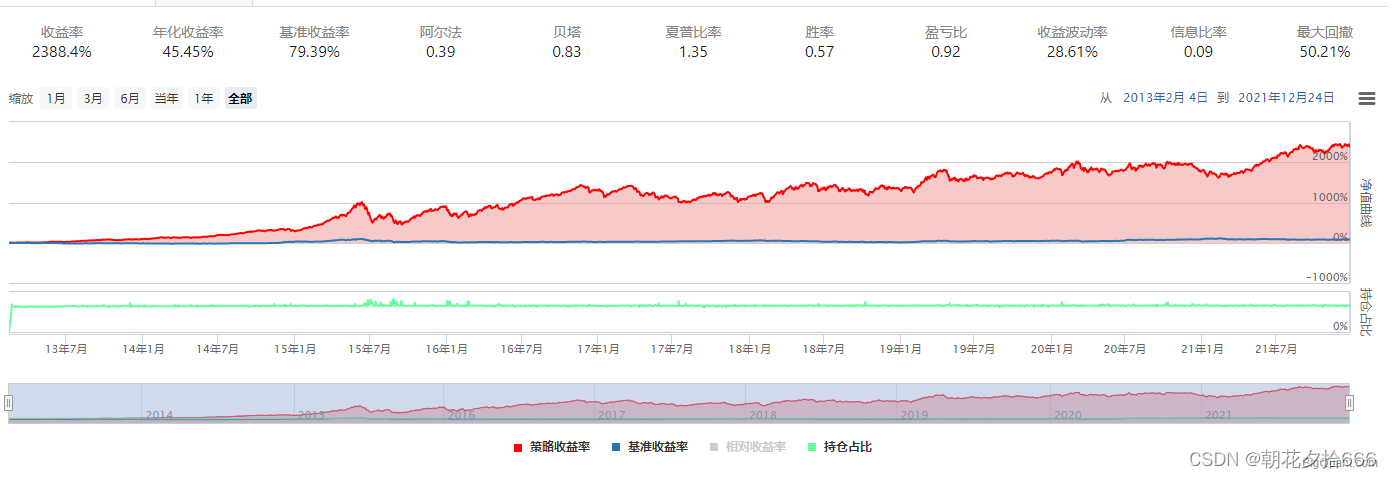

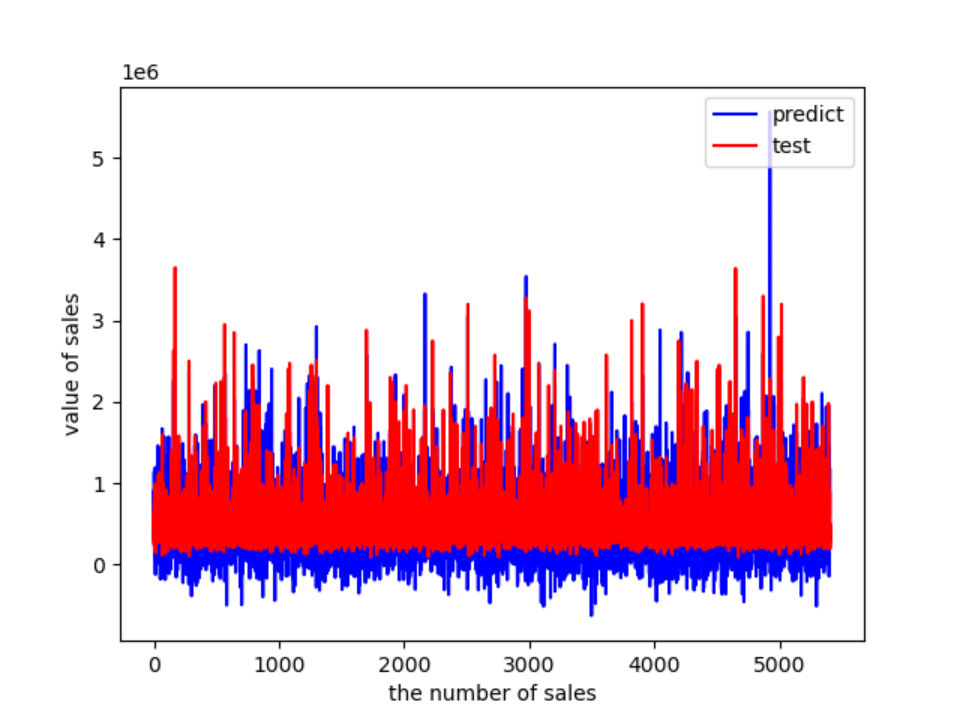

量化交易学习笔记:XGBoost 在量化选股中的应用

一、引言

本篇文章通过借鉴传统机器学习算法——XGBoost——对相同的量价因子进行实验,方便与深度学习模型进行对比实践。

二、算法介绍

XGBoost 是在 Gradient Boosting(梯度提升)框架下实现的机器学习算法,全称为“极限梯度提…

C++_开发_Boost开源库_介绍_使用

文章目录 一、Boost库简介1、功能强大:2、构造精良:3、跨越平台:4、代码开源,完全免费:5、Boost库的大多数组件不需要编译链接。6、Boost的独特之处:7、分类1、字符串和文本处理库2、容器库3、迭代器库4、算法库5、函数对象和高阶编程库6、泛型编程库7、…

决策树的Boosting策略是什么

在决策树的Boosting策略中,最常见的算法是梯度提升决策树(Gradient Boosting Decision Trees,简称GBDT)。GBDT是一种集成学习方法,通过串行训练多个决策树,并根据前一个树的预测结果来调整下一个树的训练目…

机器学习——boosting之XGBoost(未完)

划水一整天,模型看了仨!不错,虽然现在在打哈欠,还是很想把XGBoost梳理梳理 先从名字开始 XGBoost,eXtreme Gradient Boosting: em。。。。不理解 书上说,XGBoost有很好的性能,在各大比赛中大放异…

机器学习(23)---Boosting tree(课堂笔记)

文章目录 一、知识记录二、题目2.1 题目12.2 题目22.3 答案书写 一、知识记录 二、题目

2.1 题目1 2.2 题目2 2.3 答案书写

Boosting算法总览

Boosting

本章节讲解提升算法,主要是提升树,提升树实际上是采用加法模型和前向分步算法,并且以决策树为基学习器。下面我们就依次来介绍这几个概念

Additive Model

下面我们来看加法模型,加法模型的定义非常简单,其…

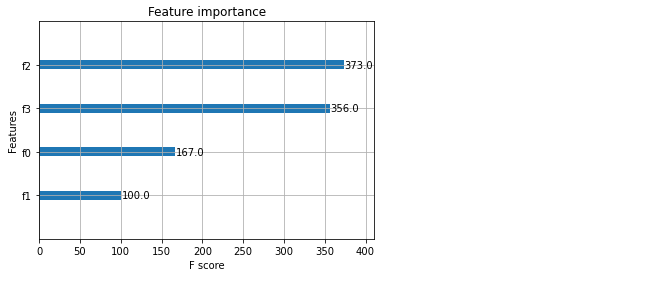

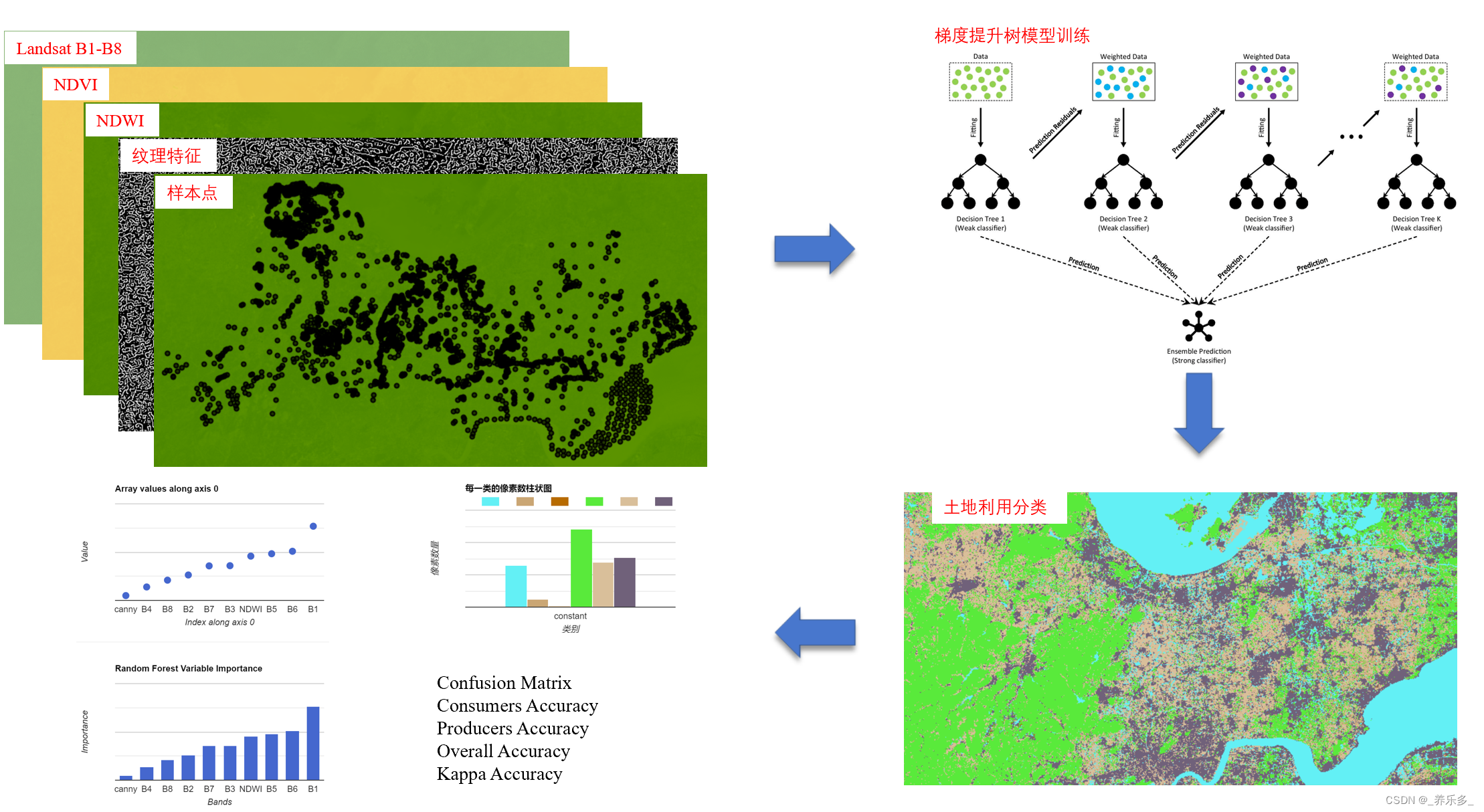

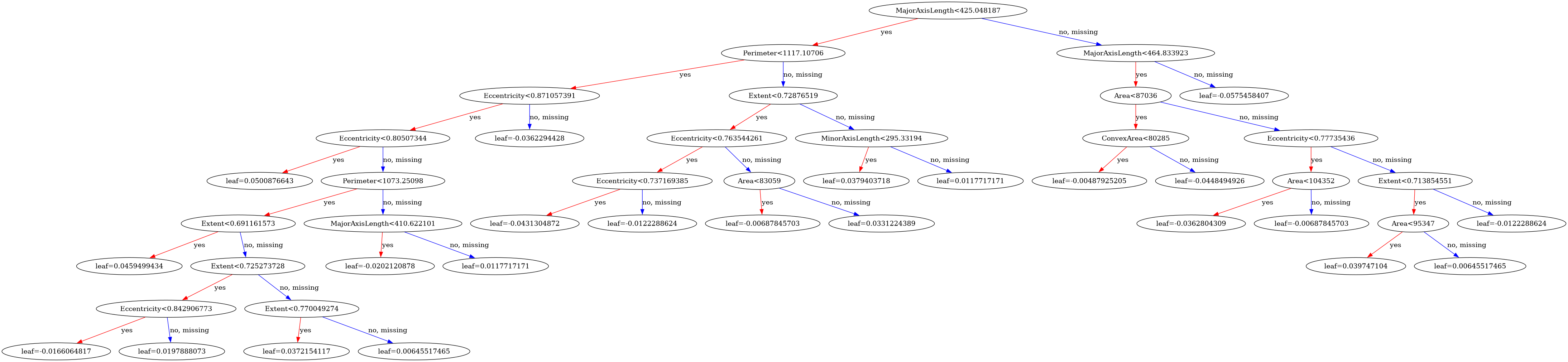

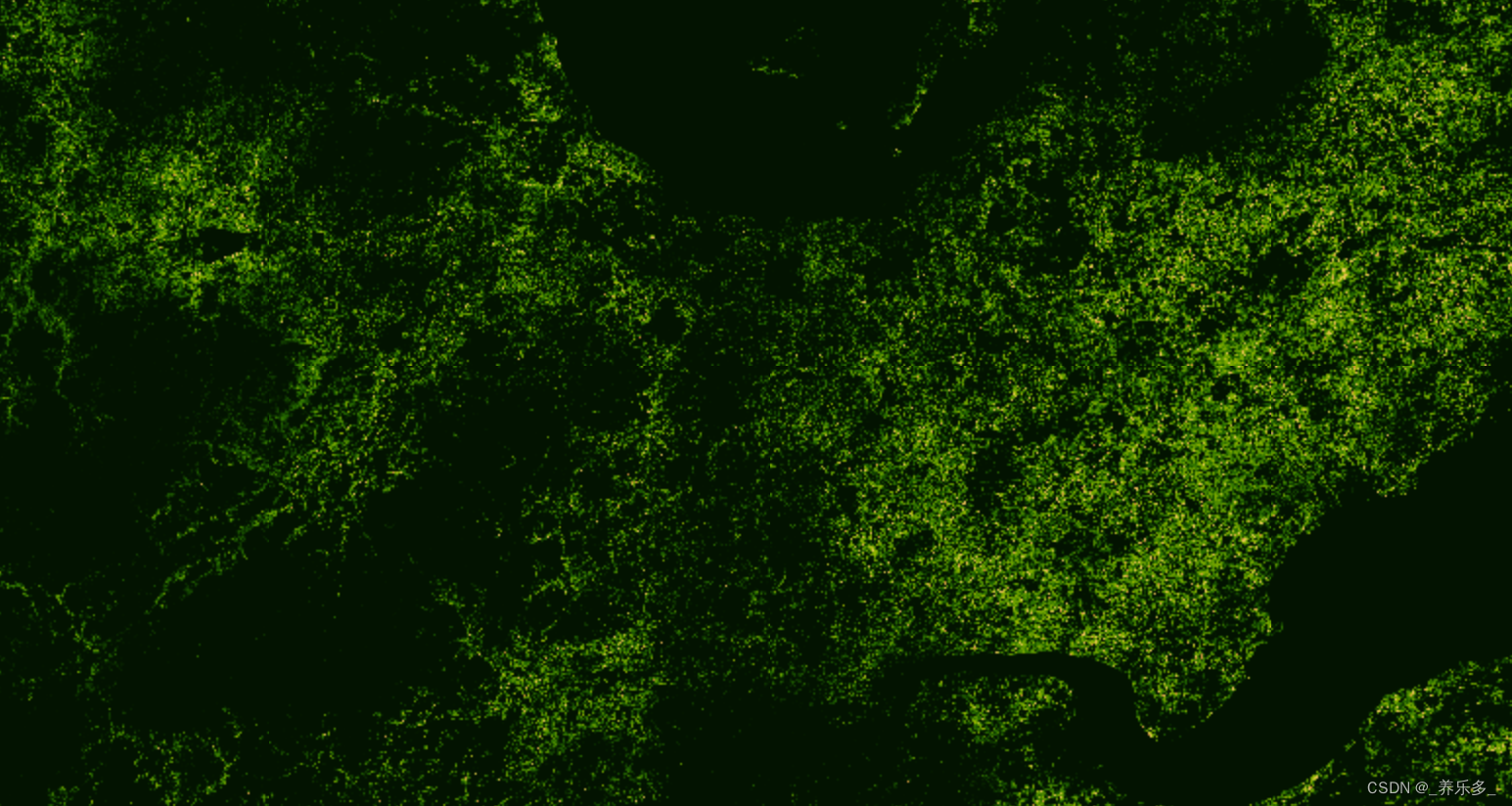

GEE:梯度提升树(Gradient Boosting Tree)分类教程(样本制作、特征添加、训练、精度、参数优化、贡献度、统计面积)

作者:CSDN @ _养乐多_

本文将介绍在Google Earth Engine (GEE)平台上进行梯度提升树(Gradient Boosting Tree)分类的方法和代码,其中包括制作样本点教程(本地、在线和本地在线混合制作样本点,合并样本点等),加入特征变量(各种指数、纹理特征、时间序列特征、物候特征…

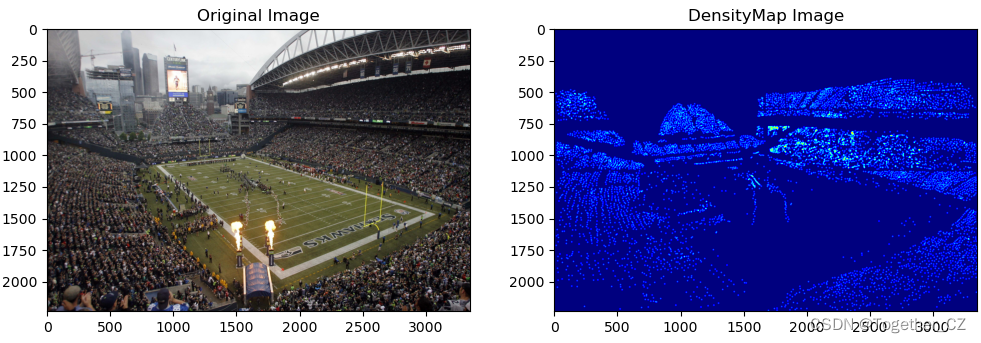

Boosting Crowd Counting via Multifaceted Attention之人群密度估计实践

这周闲来无事,看到一篇前不久刚发表的文章,是做密集人群密度估计的,这块我之前虽然也做过,但是主要是基于检测的方式实现的,这里提出来的方法还是比较有意思的,就拿来实践一下。论文在这里,感兴…

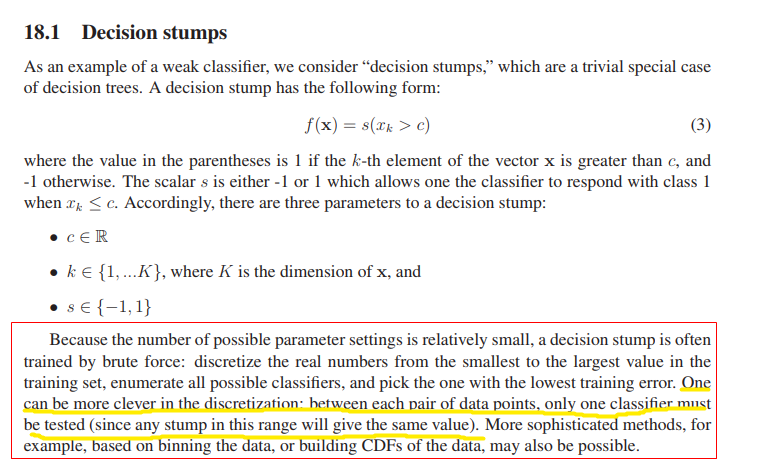

机器学习---Boosting

1. Boosting算法

Boosting思想源于三个臭皮匠,胜过诸葛亮。找到许多粗略的经验法则比找到一个单一的、高度预

测的规则要容易得多,也更有效。

预测明天是晴是雨?传统观念:依赖于专家系统(A perfect Expert) 以“人无…

机器学习_集成学习之Boosting(提升较弱的模型,以降低弱模型的偏差)

文章目录 介绍AdaBoost算法梯度提升算法(GBDT)极端梯度提升(XGBoost)Bagging 算法与 Boosting 算法的不同之处 介绍

Boosting 的意思就是提升,这是一种通过训练弱学习模型的“肌肉”将其提升为强学习模型的算法。要想在机器学习竞赛中追求卓越,Boosting…

数据分析 | Boosting与Bagging的区别

Boosting与Bagging的区别 Bagging思想专注于降低方差,操作起来较为简单,而Boosting思想专注于降低整体偏差来降低泛化误差,在模型效果方面的突出表现制霸整个弱分类器集成的领域。具体区别体现在如下五点: 弱评估器:Ba…

机器学习算法(11)——集成技术(Boosting——梯度提升)

一、说明 在在这篇文章中,我们学习了另一种称为梯度增强的集成技术。这是我在机器学习算法集成技术文章系列中与bagging一起介绍的一种增强技术。我还讨论了随机森林和 AdaBoost 算法。但在这里我们讨论的是梯度提升,在我们深入研究梯度提升之前…

《机器学习公式推导与代码实现》chapter14-CatBoost

《机器学习公式推导与代码实现》学习笔记,记录一下自己的学习过程,详细的内容请大家购买作者的书籍查阅。

CatBoost

CatBoost是俄罗斯搜索引擎巨头Yandex于2017年开源的一款GBDT计算框架,因能够高效处理数据中的类别特征而取名为CatBoost(C…

10_集成学习方法:随机森林、Boosting

文章目录 1 集成学习(Ensemble Learning)1.1 集成学习1.2 Why need Ensemble Learning?1.3 Bagging方法 2 随机森林(Random Forest)2.1 随机森林的优点2.2 随机森林算法案例2.3 随机森林的思考(--->提升学习) 3 随机森林(RF&a…

机器学习算法(12) — 集成技术(Boosting — Xgboost 分类)

一、说明 时间这是集成技术下的第 4 篇文章,如果您想了解有关集成技术的更多信息,您可以参考我的第 1 篇集成技术文章。 机器学习算法(9) - 集成技术(装袋 - 随机森林分类器和...... 在这篇文章中,我将解释…

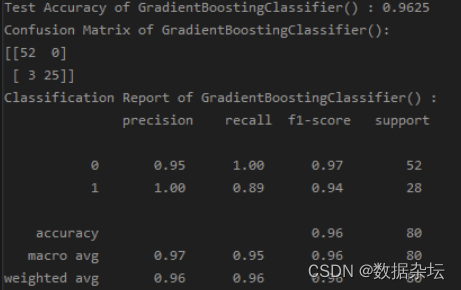

Python机器学习实战-建立Gradient Boosting模型预测肾脏疾病(附源码和实现效果)

实现功能

建立Gradient Boosting模型预测肾脏疾病

实现代码

import pandas as pd

import warnings

warnings.filterwarnings("ignore")

pd.set_option(display.max_columns, 26)#读取数据

df pd.read_csv("E:\数据杂坛\datasets\kidney_disease.csv")

…

葫芦书笔记----集成学习

集成学习

集成学习是一大类模型融合策略和方法的统称。

集成学习的种类

集成学习分哪几种?它们有何异同?

速记:Boosting(串行);Bagging(并行)

详细:

Boosting

Boo…

监督学习 - XGBoost(eXtreme Gradient Boosting)

什么是机器学习

XGBoost(eXtreme Gradient Boosting)是一种梯度提升树算法,它在梯度提升框架的基础上引入了一些创新性的特性,以提高模型性能和训练速度。XGBoost在解决结构化数据的分类和回归问题上表现出色,成为许多…

探究GBDT算法:从Boosting到特征工程

❤️觉得内容不错的话,欢迎点赞收藏加关注😊😊😊,后续会继续输入更多优质内容❤️👉有问题欢迎大家加关注私戳或者评论(包括但不限于NLP算法相关,linux学习相关,读研读博…

mmlspark.lightgbm.LightGBMClassifier参数明

mmlspark.lightgbm.LightGBMClassifier 是一个用于二元分类和多类分类的机器学习模型,它是基于 Microsoft ML for Apache Spark (MMLSpark) 库的。这个类是为了在Spark环境中使用LightGBM实现,提供了大量的参数用于调整模型。下面是一些主要参数的详细中…

机器学习之集成学习 XGBoost 附代码解析

概念

XGBoost(eXtreme Gradient Boosting)是一种用于机器学习的开源软件库,它实现了梯度提升框架。梯度提升是一种集成学习技术,通过组合多个弱学习器(通常是决策树)来构建一个强学习器。XGBoost 在梯度提升算法的基础上引入了一些创新,使其在性能上更为优越。

特点

…

集成学习和Boosting原理总结

接自https://blog.csdn.net/Y_hero/article/details/88376573 bagging与随机森林。

1.集成学习 集成学习(ensemble learing)通过构建并结合多个学习器来完成学习任务,有时也被称为多酚类器系统(multi-classifier system),基于委员会的学习(sommittee-baseslearing)…

集成学习之Boosting方法系列_XGboost

文章目录 【文章系列】【前言】【算法简介】【正文】(一)XGBoost前身:梯度提升树(二)XGBoost的特点(三)XGBoost实际操作1. 前期准备(1)数据格式(2)…

Gradient Boosting详解

Gradient Boosting是一种集成学习方法,通过迭代地训练弱分类器来构建一个强分类器。与AdaBoost类似,Gradient Boosting也关注之前轮次中被错误分类的样本,但是它的思想更加一般化,可以用于回归问题和分类问题。以下是Gradient Boo…

【机器学习】集成学习算法之AdaBoost

文章目录 基本步骤示例生成第 1 棵决策树生产第 2 棵决策树生成第 T 棵决策树加权投票 sklearn 实现 基本步骤

首先,是初始化训练数据的权值分布 D 1 D_1 D1。假设有 m m m 个训练样本数据,则每一个训练样本最开始时,都被赋予相同的权值…

解密人工智能:KNN | K-均值 | 降维算法 | 梯度Boosting算法 | AdaBoosting算法

文章目录 一、机器学习算法简介1.1 机器学习算法包含的两个步骤1.2 机器学习算法的分类 二、KNN三、K-均值四、降维算法五、梯度Boosting算法和AdaBoosting算法六、结语 一、机器学习算法简介

机器学习算法是一种基于数据和经验的算法,通过对大量数据的学习和分析&…

Boosting Bagging Stacking Mapping 区别

Boosting: Boosting 是一种集成学习技术,其中多个机器学习模型(通常是决策树)被顺序训练。每个后续模型都关注先前模型所犯的错误,对错误分类的数据点给予更多权重。这样,Boosting 就会结合这些弱模型的预测…

集成学习的两种常见策略:bagging VS. boosting

chatGPT回答,记在这里。

集成学习是一种通过组合多个弱学习器来构建一个更强大的学习器的方法。其中,bagging和boosting是两种常见的集成学习策略。

一、bagging & boosting 简介

Bagging(自助聚集法): Bagging…

6、【集成学习】之bagging、boosting、stacking浅析

- Bagging:最典型的就是随机森林(并行构造树运算取平均)- 随机:必须让每棵树都呈现出一个差异化,也就是随机--‘数据采样随机(有放回的抽样)、特征选择随机’- 森林:很多个决策树并行…

机器学习算法——详细介绍 集成学习,以及什么是Bagging、随机森林、Boosting、XGBoost

目录一、集成学习算法简介1、什么是集成学习2、机器学习的两个核心任务3、集成学习中boosting和Bagging4、小结二、Bagging和随机森林1、Bagging集成原理2、随机森林构造过程3、随机森林api介绍4、随机森林预测案例4.1、案例背景4.2、步骤分析4.3、代码实现5、bagging集成优点6…

机器学习中的算法(1)-决策树模型组合之随机森林与GBDT

原文地址为:

机器学习中的算法(1)-决策树模型组合之随机森林与GBDT版权声明: 本文由LeftNotEasy发布于http://leftnoteasy.cnblogs.com, 本文可以被全部的转载或者部分使用,但请注明出处,如果有问题,请联系wheeleastgm…

总结:Bootstrap(自助法),Bagging,Boosting(提升)

前言 最近在理清一些很必要的也很基础的东西,记录一下,结合网上和文献,自己也有些易化使之更轻松理解,如有错误,请不吝赐教,多谢! Bootstrap(自助法) Bootstrap是一种抽样方法 核心思想 子样本之…

监督学习 - 梯度提升回归(Gradient Boosting Regression)

什么是机器学习

梯度提升回归(Gradient Boosting Regression)是一种集成学习方法,用于解决回归问题。它通过迭代地训练一系列弱学习器(通常是决策树)来逐步提升模型的性能。梯度提升回归的基本思想是通过拟合前一轮模…

Boosting 算法(AdaBoost,sklearn 代码示例,提升树)

文章目录AdaBoost 算法Boosting 的基本思路AdaBoost 算法提升树提升树模型提升树算法梯度提升ReferencesBoosting 是一种常用的机器学习方法,应用广泛且有效。在分类问题中,它通过改变训练样本的权重学习多个弱分类器,由这些弱学习器的预测结…

机器学习 | 深入集成学习的精髓及实战技巧挑战

目录

xgboost算法简介

泰坦尼克号乘客生存预测(实操)

lightGBM算法简介

《绝地求生》玩家排名预测(实操) xgboost算法简介

XGBoost全名叫极端梯度提升树,XGBoost是集成学习方法的王牌,在Kaggle数据挖掘比赛中,大部分获胜者用了XGBoost。…

Boosting之GBDT原理

前面介绍了Adaboost的相关原理,实现,应用,本文主要介绍Boosting算法的另外一个重要算法:GBDT(Gradient Boosting Decison Tree)。GBDT有很多简称,如GBT(Gradient Boosting Tree), GTB(Gradient Tree Boosting …

【机器学习】Boosting算法-梯度提升算法(Gradient Boosting)

一、原理 梯度提升算法是一种集成学习方法,它可以将多个弱分类器或回归器组合成一个强分类器或回归器,提高预测性能。梯度提升算法的核心思想是利用损失函数的负梯度作为残差的近似值,然后用一个基学习器拟合这个残差,再将其加到之…

第七章.集成学习(Ensemble Learning)—提升(boosting),Stacking,Voting (投票算法),总结

第七章.集成学习 (Ensemble Learning) 7.2 集成学习—提升(boosting),Stacking,Voting (投票算法)

集成学习就是组合多个学习器,最后得到一个更好的学习器。 1.常见的4种集成学习算法

个体学习器之间不存在强依赖关系,袋装(bagging…

机器学习总结二:boosting之GBDT、XGBT原理公式推导

一、Bagging之决策树、随机森林原理与案例

二、boosting之GBDT、XGBT原理推导与案例

三、SVM原理推导与案例

四、逻辑回归与反欺诈检测案例

五、聚类之K-means Boosting

1. 简介

通过在数据上构建多个弱评估器,汇总所有弱评估器的建模结果,以取得比…

梯度提升机(Gradient Boosting Machines,GBM)

什么是机器学习

梯度提升机(Gradient Boosting Machines,GBM)是一种集成学习方法,通过将多个弱学习器(通常是决策树)组合成一个强学习器来提高模型的性能。GBM的训练过程是通过迭代,每一步都根…

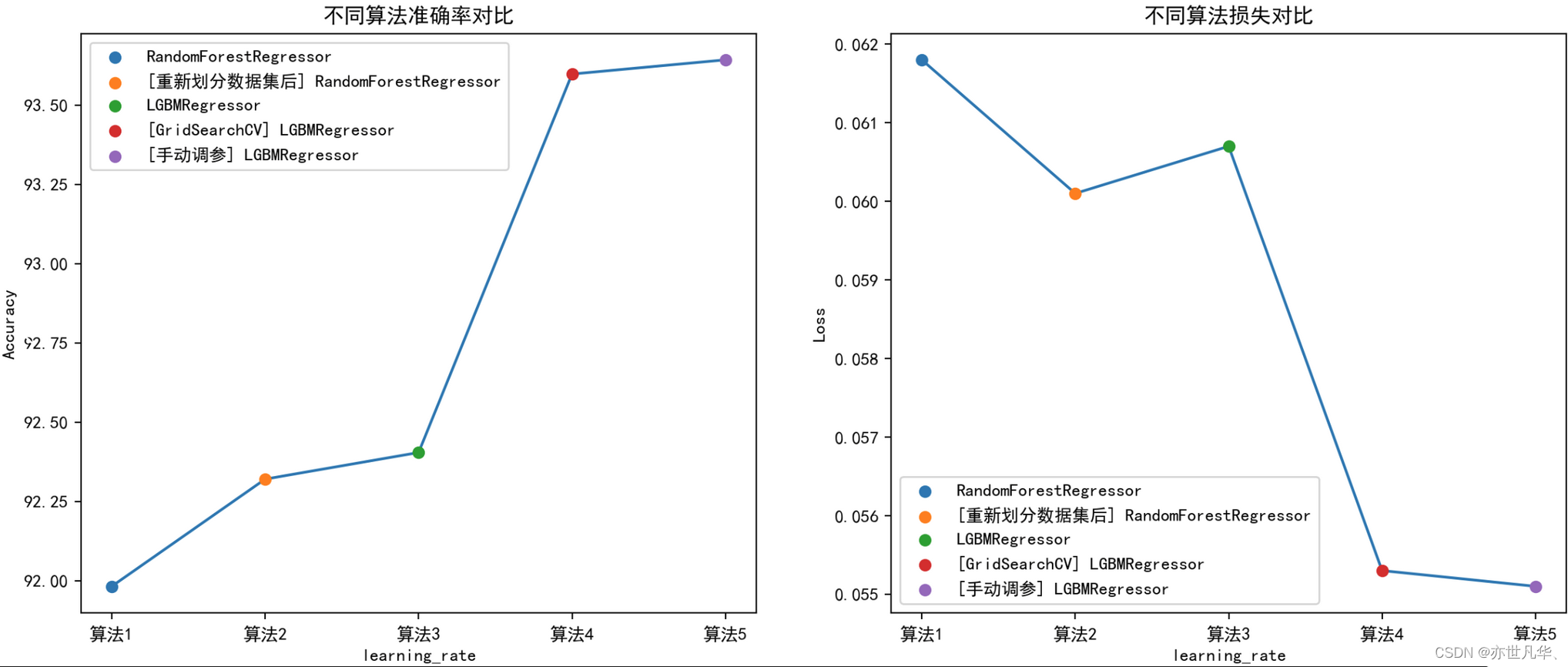

机器学习实验报告-集成学习

目录

一、集成学习介绍

1.1集成学习的引入

1.2集成学习发展史

1.3集成学习的学习组织方式

1.3.1并联组织关系

1.3.2串联组织关系

1.4集成学习及其实现方法概述

二、集成学习实现方法

2.1Boosting

2.1.1基本过程

2.1.2注意点

2.2bagging

2.2.1基本过程

2.2.2注意点…

GEE:梯度提升树(Gradient Boosting Tree)回归教程(样本点、特征添加、训练、精度、参数优化)

作者:CSDN @ _养乐多_

对于分类问题,这个输出通常是一个类别标签 ,而对于回归问题,输出通常是一个连续的数值。回归可以应用于多种场景,包括预测土壤PH值、土壤有机碳、土壤水分、碳密度、生物量、气温、海冰厚度、不透水面积百分比、植被覆盖度等。

本文将介绍在Google…

sklearn处理离散变量的问题——以决策树为例

最近做项目遇到的数据集中,有许多高维类别特征。catboost是可以直接指定categorical_columns的【直接进行ordered TS编码】,但是XGboost和随机森林甚至决策树都没有这个接口。但是在学习决策树的时候(无论是ID3、C4.5还是CART)&am…